Les images générées par l’IA : diversité et émergence

Les outils de génération visuelle (DALL·E, Midjourney, etc.) peuvent produire une grande variété d’images. Il y a notamment :

Illustrations et concept art : dessins originaux, graphismes ou logos créés par IA. Ces visuels stylisés sont utilisés sur des sites web ou dans des articles.

Portraits hyperréalistes : photos de personnes fictives (parfois appelés « personnes synthétiques ») pour avatars ou publicités. On peut générer des visages d’“inconnus” très convaincants.

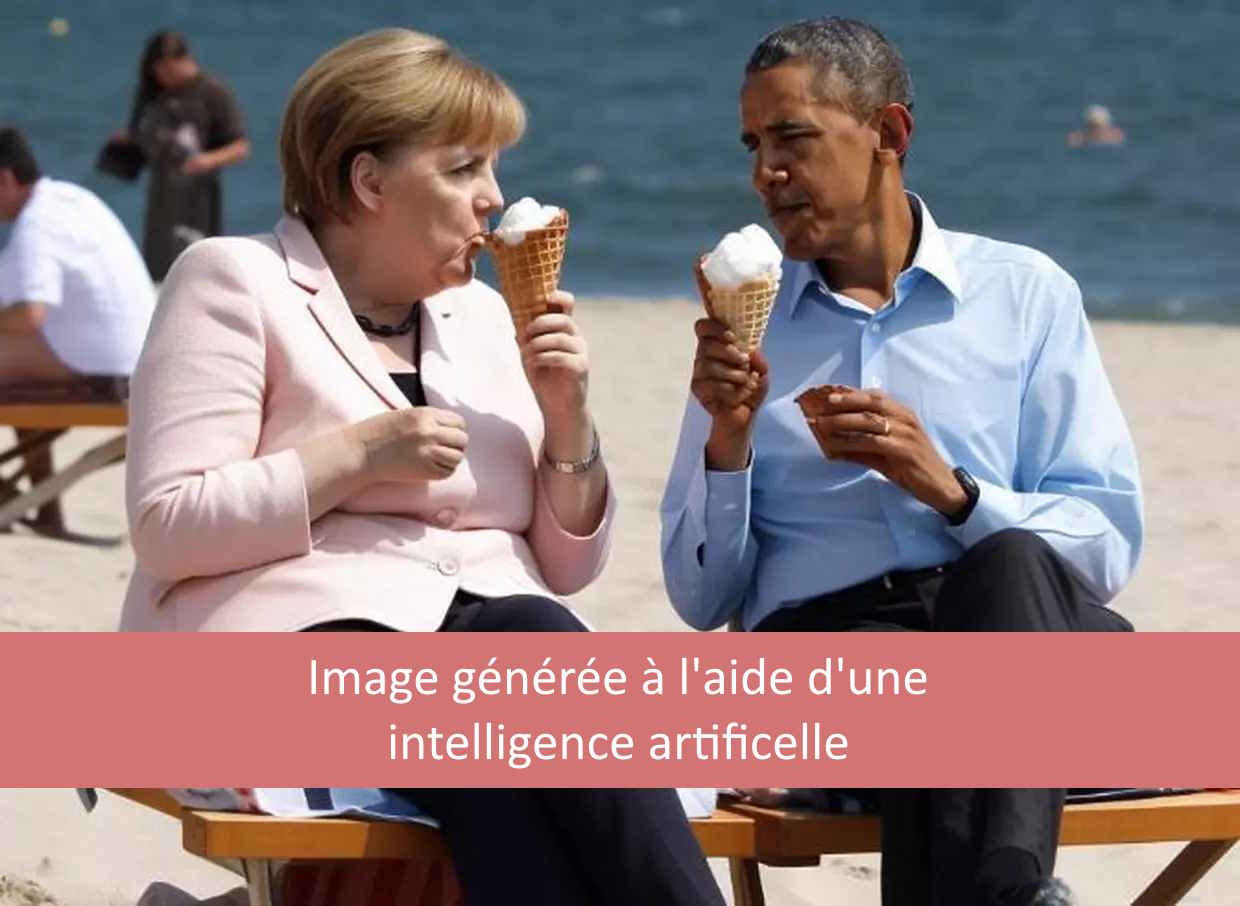

Scènes réalistes ou historiques : reconstitutions photographiques d’événements passés ou imaginaires. Par exemple, des IA ont créé des images d’un sauvetage en mer du XVIIIᵉ siècle ou de figures historiques plaçant un roman national dans un contexte anachronique [lemonde.fr].

Images à contenu textuel : affiches, publicités, documents contenant du texte (articles de journaux, panneaux, tweets montés…). L’IA a encore des difficultés à produire du texte impeccable, ce qui donne souvent des lettres et numéros fantaisistes.

Mèmes et contenus humoristiques : visuels détournés ou comiques (parodies, images satiriques) générés pour les réseaux sociaux. Par exemple, on trouve des mèmes historiques créés par IA, jouant sur l’anachronisme (un bus moderne parmi l’armée en terre cuite). [lemonde.fr]

Ainsi, des images d’illustration graphique jusqu’aux scènes photo-réalistes en passant par des « mèmes » ou des captures textuelles, l’IA couvre toutes ces catégories. Cette diversité explique l’attrait et la propagation rapide de ces technologies dans les médias, la publicité et les réseaux sociaux, d'où l'importance d'être sensibilisé à l'usage de ces technologies.

Les dangers liés à l’utilisation des images IA

Les images générées par IA exposent à plusieurs risques majeurs :

Désinformation et manipulation d’opinion. Des images IA peuvent falsifier des événements (scènes de guerre, manifestations, etc.) pour tromper le public. Par exemple, des photos truquées placent arbitrairement des personnages historiques dans des contextes différents. Une enquête de Le Monde note qu’on génère facilement des fausses « archives photo », comme des phalanstères russes ou Rouget de Lisle chantant la Marseillaise, exploitant des détails anachroniques pour duper l’audience lemonde.fr. Au niveau politique, des fausses images de candidats (ex. Donald Trump entouré de partisans inédits) ont circulé en 2024 pour semer la confusion électorale apnews.com. Une étude de chercheurs anglophones montre ainsi qu’avec l’IA on peut créer en un clin d’œil des montages photoréalistes d’un président échangeant des pots-de-vin ou d’un fonctionnaire truquant des votes, alors même que ces outils affichaient des garde-fous contre de tels contenus apnews.com. Ces manipulations visuelles peuvent alors influencer l’opinion publique et par conséquent une élection.

Escroqueries et canulars. L’IA facilite la création de faux profils ou scénarios idéals dans le cadre d'arnaques. Des cybercriminels génèrent par exemple de faux profils attrayants (photos de visage réalistes) pour des arnaques sentimentales ou de phishing masecurite.interieur.gouv.fr. Plus récemment, un phénomène viral (#HomelessManPrank) a vu des individus envoyer à leurs proches une image réaliste d’un « sans-abri » présent chez eux, suscitant de fausses alertes à la police lanouvelletribune.info. Ce canular mobilise inutilement les secours et fait courir des risques (les policiers pourraient intervenir sous de faux prétextes). Au-delà des farces, l’IA est utilisée dans des escroqueries financières : fausses annonces d’emploi promettant des gains mirobolants, faux investissements, ou clonage de voix pour arnaquer en se faisant passer pour un proche masecurite.interieur.gouv.fr.

Stéréotypes et biais amplifiés. Les générateurs d’images reproduisent souvent les biais des données d’entraînement. Ils tendent à sexualiser par défaut les corps féminins, à représenter certaines professions de façon genrée, et à afficher majoritairement des visages blancs. Par exemple, un projet artistique a montré comment différents outils IA génératifs produisaient des stéréotypes marqués selon le genre ou l’origine. Une IA occidentale peut dessiner une femme asiatique en style manga érotique, tandis qu’une IA chinoise utilisera davantage un style de dessin animé plus modéré sporobole.org. Ces biais véhiculent des stéréotypes sociaux ou culturels et peuvent perpétuer des discriminations.

Confusion dans les preuves visuelles. Enfin, la crédibilité même de la photo comme preuve peut être érodée. Par exemple, en justice, il devient possible de contester une image ou une vidéo en affirmant qu’elle est générée par IA. Les experts en droit craignent que les deepfakes rendent la vérification plus complexe et sapent la confiance dans les éléments visuels présentés comme preuves apnews.com. À terme, lorsqu’un nombre croissant d’images peut être « faux », l’audience peut douter de n’importe quelle source visuelle, légitime ou non apnews.com.

Comment reconnaître une image générée par IA : indices visuels et contextuels

Plusieurs traits visuels peuvent trahir une image générée artificiellement :

Incohérences anatomiques. Les outils IA peinent souvent avec les détails complexes du corps humain. Les yeux peuvent être mal formés (pupilles déformées, asymétrie) ou les traits flous. Les mains sont particulièrement fragiles : on y voit fréquemment un mauvais nombre de doigts, des articulations bizarres ou des positions impossibles. Les dents ou oreilles peuvent aussi paraître irréalistes.

Erreurs de texture et de fusion. Les cheveux et les tissus se mélangent parfois de façon étrange. Les générateurs peuvent confondre la fin d’une mèche avec l’arrière-plan, ou fusionner plusieurs vêtements sans logique. Des détails parfaitement alignés (des boutons mal placés, des plis de tissu incohérents) sont des signaux d’alerte. Des éléments « fantômes » peuvent apparaître (objets partiellement formés, visages dédoublés dans l’arrière-plan).

Arrière-plans et compositions bizarres. Les fonds d’image IA manquent souvent de cohérence spatiale. On peut y repérer des objets dupliqués (par exemple une chaise en double), des perspectives impossibles (une pièce où un mur est soudain cassé), ou des régions floues sans raison. L’éclairage est aussi suspect : l’IA génère mal les reflets ou les ombres complexes. On observe parfois des ombres mal orientées ou des reflets absents sur des surfaces réfléchissantes.

Texte et logos aberrants. Les générateurs actuels créent mal le texte. Une image IA montrera souvent un écrit incompréhensible : lettres biscornues, mots tronqués ou répétitifs. Toute inscription (panneau, écran, journal) présente sur l’image est suspecte. De même, les logos ou emblèmes sont typiquement mal rendus (inversions de lettres, symbole déformé).

Perfection excessive. À l’inverse, les IA produisent des visages « trop parfaits », lisses et très symétriques. Cette qualité trop uniforme peut sembler artificielle. Un humain remarquant qu’une photo est « trop belle pour être vraie » doit se méfier. Plus généralement, l’analyse contextuelle est indispensable : si l’image est liée à une info sans source précise, ou si l’événement n’a pas été rapporté ailleurs, la prudence s’impose.

En résumé, un bon réflexe est d’examiner les détails visuels et de garder l’esprit critique. Comme le conseille la CNIL et le gouvernement, contrôlez systématiquement l’authenticité et la provenance : une recherche d’image inversée (Google Images, TinEye) peut révéler une origine douteuse. Un nom de fichier trop générique (« image d’IA 123.png »), des métadonnées manquantes, ou le fait que l’outil de génération (DALL·E, Midjourney) appose parfois un filigrane, sont autant d’indices techniques possibles.

Outils publics pour détecter les images IA

Plusieurs services en ligne gratuits ou commerciaux permettent d’analyser un visuel pour évaluer son caractère IA. Parmi les plus accessibles on compte :

Sightengine (gratuit jusqu’à 2000 analyses/mois). Ce site web indique un pourcentage de probabilité qu’une image soit générée artificiellement et signale les anomalies principales (détection de visage manipulé, etc.). Il identifie parfois le modèle IA utilisé (ChatGPT-4o, Stable Diffusion, etc.) à partir de l’empreinte visuelle.

AI or Not. Disponible en ligne (version gratuite limit 10 images/mois), il analyse les images pour détecter les traces d’IA. Il donne un score de certitude et, en débloquant l’interface, on peut même voir quel générateur est suspecté.

Illuminarty (illuminarty.ai) propose un détecteur gratuit et illimité. Ce service signale la probabilité que l’image vienne d’un modèle IA public. En tests, il donne des résultats fiables, bien que parfois avec moins de certitude que d’autres outils.

Reverse image search. Les classiques Google Images, TinEye ou Yandex peuvent repérer des copies d’une image sur le web (par exemple si elle provient d’une banque d’images ou a déjà été utilisée).

FotoForensics et Forensically. Ce sont des outils d’analyse forensique qui appliquent des filtres (comme la détection d’erreur de compression) pour révéler des retouches. Elles ne détectent pas explicitement l’IA mais peuvent montrer des zones de l’image anormalement bruitées ou clonées.

Toutefois, ces outils ne sont pas infaillibles (certains modèles récents peuvent échapper aux détecteurs), mais ils constituent un premier filtre utile. Il faut croiser plusieurs méthodes (examen visuel + outil) pour augmenter les chances de détection. Comme le suggère Codeur.com, la vérification manuelle reste essentielle : examiner l’image à la loupe, relever les détails incohérents, et s’interroger sur la crédibilité de la situation.

En somme, face à la prolifération des images IA, la clé est l’esprit critique et l’éducation. Comme le soulignent les experts, « bien souvent, les images qui proviennent d’une IA sont bien trop belles pour être vraies ». En pratiquant systématiquement la vérification (métadonnées, source, recherche inversée) et en repérant les incohérences, chacun – journaliste ou citoyen – peut limiter l’influence de ces faux visuels.